AR(拡張現実)イノベーションで実現する未来とは?

ARKit・ARCoreという簡単にスマホでAR体験を作ることができるSDKが2017年にリリース、2018年には、Magicleap OneなどのヘッドマウントARデバイスがリリースされ、AR(拡張現実)がより注目されるようになってきております。

Graffityは、2017年10月に創業し、いち早くARイノベーションに取り組んできました。AR体験を仮説検証していく中で、多くのことがわかってきました。日本から世界へARベンチャーが活躍できるよう微力ではありますが、AR(拡張現実)に関することをまとめて行きたいと思います。

目次

ARの体験とは?

AR体験はコンテキストを理解すること

まず、多くの人が勘違いしていることがあります。それは今まで出てきているアプリを見れば一目瞭然です。

すごい!恐竜が出た!と思うひとが多いと思いますが、このようなアプリがとにかく多いです。

なぜそこに恐竜が出るのかという、コンテキスト はここに全くありません。

一度、すごい!とは思いますが、二度目体験したいと思わないでしょう。

上記をうらずけるような動きがあり、Apple、Googleでは、このようなただ空間に何かを出す体験を提供するアプリを承認しなくなってきています。

AR体験は、リアルタイムな画像データと位置情報からコンテキストを理解し、現実世界を拡張する体験なのです。

AIとARの関係

リアルタイムな画像データからどのようにコンテキストを理解することができるのか?

そこで重要になってくるのは、AIにより大きく発展した画像処理技術です。

AIは今後大きくマーケットが伸びていくと言われていますが、AIのコンシューマー向けの事業は何でしょうか?

DeepLearningによりAIは大きく発展して行きましたが、その中で大きく伸びている分野は、画像処理と言語処理です。

言語処理のコンシューマー向けの事業として考えられるのはボット事業ですが、もともとAIの研究をしていた自分の中では、言語処理のDeepLearningで人間のような受け答えを実現することは非常に困難です。ボット事業で今伸びている会社も、DeepLearningではなく、古典的な機械学習技術を使い、ルールベースで作っています。ここが本命ではありません。

そうすると、画像処理に注目するわけですが、まさにこの画像処理を用いてコンシューマの市場が、AR(拡張現実)市場になります。

つまり、AIのコンシューマー事業でもっとも成長する市場はAR(拡張現実)市場なわけです。

ARデバイスとAR体験

3つのARデバイス

ここでAR(拡張現実)といえば!と想像するものとは何でしょう?

一般的に想像するのはSFの世界、SAOの映画版の世界観でしょう。

この世界の実現はまだまだ時間がかかります。期待しすぎています。

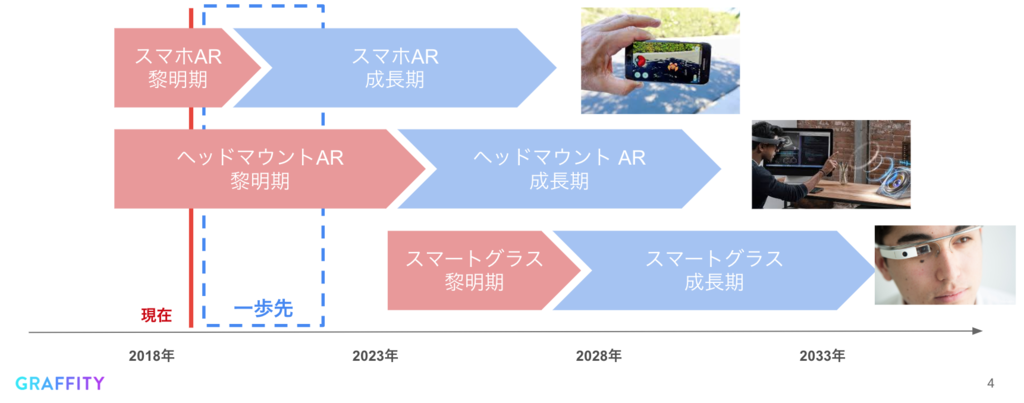

ARイノベーションは3つのステップを踏んで、このような世界になって行きます。

スマホAR -> ヘッドマウントAR -> スマートグラスです

それぞれのARの体験

では、それぞれのAR体験はどのような体験になるでしょうか?

キーワードは、能動・受動という言葉です。

スマホARはアプリを起動して、スマホをお通して現実を見なければならない、ヘッドマウントARはデバイスを頭につけなければいけない。両方とも体験をする際に、能動的な動作が必要になります。

よって、強い動機を利用した、能動的なAR体験が今後10年は主流になってきます。

その次にやってくるのが、スマートグラス。日常的につけるウェアラブルデバイスです。

ヘッドマウントARとの違いは、軽量化・バッテリー長時間化というところでしょうか。

スマートグラス時代では、常に身につけるためAR体験は全て受動的になります。ようやくみんなが想像するAR世界の実現です。

ヘッドマウントARデバイスの普及にも時間がかかる今、注目すべきは必然とスマホARになると思います。

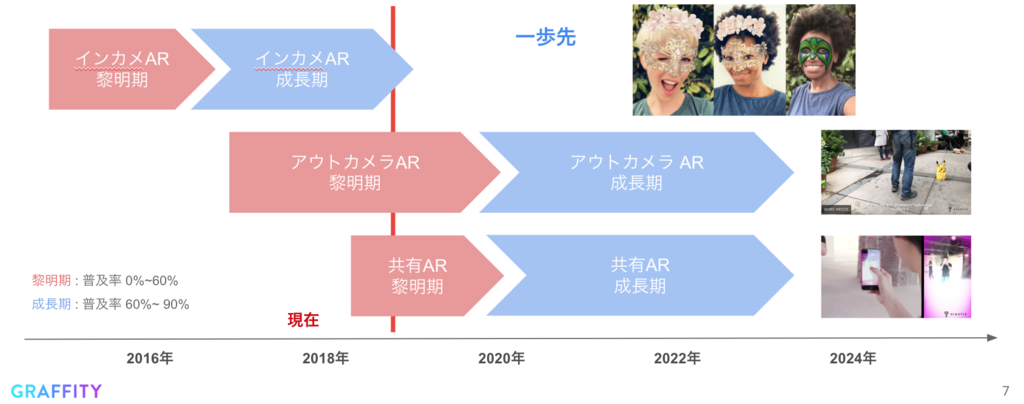

スマホARにも3つのイノベーションがありそれを具体的に紹介していきたいと思います。

3つのスマホARイノベーション

スマホARのイノベーションは3つあり、インカメラAR・アウトカメラAR・共有ARです。

ここからは、具体的にインカメラAR・アウトカメラAR・共有ARを実現する技術とそのAR体験を紹介して行きたいと思います。

インカメラARイノベーションとAR体験

インカメラARテクノロジー

インカメラARテクノロジーの中心は、顔認識技術です。こちらはDeeplearningによって大きく発展した画像処理技術の一つです。

スマホで動く顔認識技術はかなりよくなっております。取得できる特徴点の数、デプスの正確な推定ができてきつつあります。

iPhoneXでは、インカメラにセンサーが導入され画像だけなくセンサーを使ったデプス推定で、多くの特徴点を取得できるようになってます。

Snapchatも顔認識技術のオープンフレームワークをリリースしました。顔認識技術は完全にコモディティ化しており、インカメラAR市場への参入は非常に簡単なものになっております。

インカメラAR体験

インカメラARの体験の中心は、顔フィルターとして、アバターになります。

・顔フィルター

Snapchat、インスタグラム、SNOWなどを中心にユーザーが利用しております。

・アバター

こちらは、Appleが提供しているMemojiですが、日本ではVtuberを中心にユーザーが利用しております、

アウトカメラARイノベーションとAR体験

アウトカメラARテクノロジー

アウトカメラAR技術はたくさんあり、列挙すると以下のようになります。

- 画像分類

- 物体識別

- 物体追跡

- セマンティックセグメンテーション

- インスタンスセグメンテーション

- 姿勢認識

それぞれの技術の具体的な説明は、以下のブログにまとめているので、気になった方はチェックして見てください。 tech.graffity.jp

アウトカメラAR体験

アウトカメラAR体験は、リアルタイムにコンテキストを理解し、情報を表示することになってきます。

ここではPokemonGoを提供している、Niantic社がリードしております。例えばオクルージョンという技術により、リアルタイムにその場所の認識ができるようになり、ポケモンが人や物体の後ろに隠れるというリッチなAR表現ができるようになります。

また、画像検索というのAR体験の一つだと思います。

共有ARイノベーションとAR体験

共有ARテクノロジー

共有ARテクノロジーの中心となるのは、ARCloud技術。ARCloudとは現実を3D化しクラウドに保存する技術をさします。

この技術により、空間を共有、空間に保存できるようになります。

こちらも詳しくは、別の記事でまとめているので、気になった方はチェックして見てください。

共有AR体験

共有AR体験はまだどこの会社も検証中だと思いますが、Graffityではいち早く2017年に「空間に落書きを残せるアプリGraffity」をリリースしたりしてました。

そして2018年12月にGraffityではリアルタイムに共有体験として、ARシューティングバトル「ペチャバト」をリリースしました。

まとめ

様々な事例を紹介しながら、これから起こるARイノベーションを考察してきました。 未来を楽観的に予測するのではなく、現実的に見て行きました。以下が今回のポイントになってきます。

- AR体験はコンテキストをリアルタイムな画像データと位置情報を元に理解して作ること

- ARはAIによる画像処理技術をベースとしている

- ARデバイスは、スマホAR -> ヘッドマウントAR -> スマートグラス の順番に普及

- スマホARは、インカメAR -> アウトカメラAR & 共有AR の順番に普及

- インカメラARは、顔認識をベースとした、顔フィルター&アバター(Vtuber)

- アウトカメラARは、画像処理技術をベースとした体験

- 共有ARは、ARCloud技術をベースとした体験

最後に

Graffityは一年間ARの体験に関して仮説検証してきました。ペチャバトもグローバル初でこのようなAR共有体験をリリースすることができており、世界と同じ水準、さらに超えるくらいのスピードで検証できていると感じています。

ユーザーにとってAR体験とは何かを引き続き検証して、世界でもトップレベルで良いAR体験を作っていける会社を目指していきます!また来年もこのような形でまとめることができればと思います!応援よろしくお願いします!

Graffity採用情報

弊社リードエンジニアKBOYが #iOSDC 2018にて登壇しました!

こんにちは。筋肉エンジニアのKBOYです。iOSDCが開催中ですね! 私は昨年初めて参加し、今年はスピーカーとして登壇することができました。とても嬉しく思います。

さて、GraffitryではこれまでARKitを使ったアプリを開発してきました。当初は3Dの座標系について分かっていなかったため、ARKitのドキュメントや記事だけを見ても分からなかった苦い思い出があります。その試行錯誤と勉強で得られた知見を界隈に共有して盛り上げていきたいという思いがあって今回の発表を行いました。

また、優秀なiOSエンジニアが沢山いる中で自分は何で目立てるかな?と考えた時に、やはりARであるという理由もあります。なぜなら業務で本格的にARKitを使っているという珍しい存在であると自負しているからです。

発表時間には弊社社長(リーダー)も遊びに来てくれて、僕のフリに答えてくれました!w

convertPosition() 便利だよね。#iosdc #3dプログラミング勉強しろ

— ᴛᴏᴛᴛɪ | ᴀʀ (@ok_totti) 2018年8月30日

発表内容

今回発表した内容は、「ARKitのための3D算数」ということで、座標系の種類と座標変換の話を中心に扱いました。ここは僕が最初にハマった所の1つで、一見簡単そうに見えて文字だけで説明するのが難しい分野なので、いい先生がいないと理解に時間がかかると思います。

発表資料は以下です。

また、Qiitaの記事で読みやすく、行列の話も含めて書きましたのでそちらもご確認ください。

発表した感想

100人弱の人たちの前で発表できるというのはとても良い機会でした!意外と緊張せずに発表できてよかったです。

また、ARKitを使った実装に興味がある方が結構いるんだなあと感じた機会でした。これからもiOSに限らずモバイルARを追求して行くので、積極的に発信していきたいと思っています。

エンジニア募集中!

ということでGraffityでは、副業や業務委託も含めて手伝って下さるエンジニアを絶賛募集中でございます!興味がある方は是非お気軽にtwitterのDMなどでもお問い合わせください!

スタートアップがRailsからGoに移行した話(インフラ・デプロイ周り)

はじめに

GraffityというARを使った落書き通話アプリを作っているむーつんといいます。 好きな言語はJavascriptなサーバサイドエンジニアです。

弊社のAPIは元々Railsで出来ており、以下のような構成でした。

ここにはスケーラビリティは考慮されておらず、同じインスタンスをコピーしてALBに振り分けてもらうという粗末なものでした。(スピード感が求められるスタートアップにおいてはこれで良いのかも)

しかし、Graffityは過去にZIP!で取り上げて頂いたり、弊社代表の森本(以降Totti)がJ-Waveでラジオ出演するなどメディアへの露出が増える中、これではいつ大量アクセスでサーバがダウンするかわからず不安です。

ラジオ初出演!本日のJWAVE8:30〜9:00までARの未来について別所さんと話しました:) 森本節炸裂してるのですが、内容は面白いので是非!

— ᴛᴏᴛᴛɪ (@ok_totti) 2018年7月5日

もっとARの未来をわかりやすくビジョナリー伝えよう!貴重な機会ありがとうございました!#JWAVE pic.twitter.com/ozh0j4SPC7

Totti「むーつん、Goに興味ある?」

---それは突然訪れました。 森本の兼ねてからの友人のI氏(インターンでUSの某大手SNSで働いた実績がありとても優秀と聞いていた)がサーバサイドの業務にコミットしてくれることになり、彼がGoに興味があった事と森本がGoに対して持っていた可能性から僕にサーバの開発をGoに移行した方がいいのではないかと打診があったのです。

Goのコミュニティの活発さは感じていましたし、前述のような課題感からRailsからGoに移行することを決めました。

さて、Goに移行するぞい

Goに移行するに当たって、以下の要素を重要視しました。

- マイクロサービスアーキテクチャ

- PMF達成に向け、多くのプロトタイプを追加・削除しやすいこと

- サービス間通信が行えること

- Infrastructure as Code

- マネジメントコンソールを触らずともインフラが構築できること

- CI環境(デプロイ、テスト)

- ダウンタイムのないデプロイが簡単に行えること

- 自動テストを実行できること

最終的には以下のような構成になりました。

GraffityはPMF達成に向けて仮説検証を進めているフェーズです。 今後多くのプロトタイプが生まれ、破棄されていくことを想定し、コアな機能(ユーザ管理、Worker)と各APIを疎結合することでリスクなく運用できると考えました。

また、インフラ環境はTerraformにてコード化されており、マネジメントコンソールから操作することなくコードベースで構築できるようになりました。これにより、人為的操作により環境が壊れたりするリスクを抑えることができそうです。

デプロイはecs-deployを用いて行われ、

- 稼働中のサーバ(Blue)とは別のサーバ(Green)を起動する(AutoScalingGroupのMax/MinSizeを0->1以上に変更する)

- Greenにecs-deployを用いてECRからイメージをデプロイ

- テスト用サブドメインにRoute53にてGreenのロードバランサに接続

- テストコードが走る

- テストが問題なければデプロイしたいドメインに対してGreenのロードバランサを接続(Blue -> Greenにスイッチ)

- Blueサーバを停止する(AutoScalingGroupのMax/MinSizeを0に変更する)

上記コードをpythonでスクリプト化され、makeコマンドとして実行できるようになっています。

ポイントとしては、ELBに対するRoute53のTTLが60秒のため、5が完了後、60秒以内にBlueサーバを停止してしまうと、Route53はまだBlueに接続してしまうため接続エラーとなってしまいます。 なので、スクリプト内で5の後に80秒ほどスリープしてから6を実行するように調整しました。

で、結局Goにしてよかったの?

それは僕にもわかりません。 というかこれから分かってくるだろうかと思っています。

間違いなく、マイクロサービス化やなどのインフラ環境は資産になり得るポイントだと思いますが、GoにしたことによってどれくらいAPIのレスポンスが改善したか、生産性が向上したかはこれから運用していく中で感じることでしょう。

それ以上に大きなメリットとしては、将来的な移行コストの削減かなと思っています。 今後会社の規模が拡大し、一緒に働くメンバーも増えてくる中で言語や開発環境をリプレイスすることはかなりの重いタスクになる事は想像しやすい事だと思います。

今後Go2のリリースも控えているので、開発コミュニティはますます活発になっていく事でしょう。 弊社Graffityもその勢いに乗れるよう頑張ります。

おわりに

Graffityとかビデオ通話をしながらAR落書きが楽しめるアプリです。 みんなで書いた落書きを動画で保存してシェアしましょう!!

ARKitの可能性を知るためにオススメの教材2選

こんにちは。GRAFFITYでiOSを中心にアプリエンジニアをやっているKBOYです。今回はARKitの可能性を感じさせてくれる教材を紹介し、僕なりの感想も書いて行きたいと思います。

「ARKitでどんなアプリを作ったらいいのか?」という話になると、そもそもどこまでできるのか?という話になってアイデアが出にくいものです。

そのイメージを掴むために私がオススメするのは、

の2つです。

それぞれからピックアップして、ARアプリを作りたいあなたにインスピレーションを与えたいと思います。

物理的インタラクション

ARKit 2.0 Build Augmented Reality apps on iOS with Scenekit

そもそもSceneKitでこのような物理的インタラクションができます。 これを実際の空間で行うとこのように、公園でファイヤボールを投げてブロックを倒したりするゲームが作れます。

WWDC2018で紹介されたSwift Shotもこの物理的インタラクションとMulti Playの組み合わせで実現していますね。

空間に線を書く

https://github.com/shu223/ARKit-Sampler

弊社GRAFFITYでも実装されている線を書く機能。 毎フレームごとに線のnodeのgeometryを更新ことで、長い線を空間に引くことができます。

ARKit-Samplerでは中心から線を書くように実装されていますが、タッチしている位置を使うことで、手の動きに合わせて線を書くことができます。

それがGRAFFITYです。

オクリュージョン(3D物体が平面に隠れる)

ARKit 2.0 Build Augmented Reality apps on iOS with Scenekit

ARは実際に空間に物を置いているわけではなく、3Dに見えるように描画しているだけなので、そのままだと図にあるような机も通り抜けて見えてしまいます。しかし、平面認識と組み合わせることでARKitでもオクリュージョンと呼ばれる現実の物の後ろに3D物体が隠れるという表現が可能です。

先日Pokemon GOでオクリュージョン技術が注目されましたが、ARKitでも実はある程度できるということを知っといて損はないでしょう。

ドローンが近づいたら音声が聞こえる

ARKit 2.0 Build Augmented Reality apps on iOS with Scenekit

このdroneはxcode上でSceneKitのGUIで作ることができます。このデモではそれで作ったdroneをある点を中心に回るようにアニメーションさせてさらに、音声ファイルを使ってdroneから音が鳴っているように表現しています。

広い意味でARは視覚表現だけでなく、聴覚や触覚も使うとより現実味を帯びたものになります。そういった世界感を作って行きたいものですね。

画像の認識

ARKit 2.0 Build Augmented Reality apps on iOS with Scenekit

ARKit1.5からできますが、2.0でかなり精度が上がっています。図のように動かしても画像に地球がくっついてきます。

Tweet Realityの作者がAR名刺のイメージ映像を公開していましたが、物理的なものは概要Overviewだけにして、ARで詳細を表現するというアプローチは最高にクールですね。ミニマリストの僕にも刺さります笑

📱AR Business Card Concept

— Oscar Falmer (@OsFalmer) 2018年6月18日

I created this it using ARKit 2.0 with Image Tracking,

Could really be how we interact with business cards in the near future.#ARKit #iOS12 #AugmentedReality pic.twitter.com/6qB7zfLyqM

平面認識

https://github.com/shu223/ARKit-Sampler]

ARKit1.0平面認識ができますが、ARKit1.5では壁も認識できるし、gifのように短形だけでなくて円のような形も判別することができます。テーブルの上に水を張り巡らせるといったような演出ができるのです。

僕は木製のものがスクなので、全ての机を木にトランスフォームしてみたいですね笑

まとめ

以上、ARKitの可能性を感じることができたでしょうか?

堤さんのARKit-Samplerは自由に参照できますし、ARKit 2.0 Build Augmented Reality apps on iOS with Scenekitは有料ですが動画をみながらわかりやすくARKitを習得できるのでオススメです。興味のある方は見てみてください。

(本文に掲載したgithubの動画は公開されているものであり、Udemyの動画は作者から掲載の許可をもらっています。またNDA違反しないようにARKit2.0特有のスクショは載せていません)

ARイノベーションを牽引するComputerVision7選

ARは視覚の代替、拡張にあります。 ベースとなる技術である、Computer Visionは、2012年のDeepLearningのブレイクスルーにより、毎年たくさんのComputerVisionの研究が発表されることから始まりました。初めはクラウド上で動くものでしかなかったこのテクノロジーは、今やスマホでサクサク動く時代へ。 AR普及するのに欠かせない、ComputerVisionテクノロジーを今回はピックアップしたいなと思います。

INDEX

- 顔認識

- 画像分類

- 物体識別

- 物体追跡

- セマンティックセグメンテーション

- インスタンスセグメンテーション

- 姿勢認識

1. 顔認識

顔認識は、顔から特徴点を抽出するテクノロジーです。 現在利用されているARのユースケースでは、ダントツであるFaceFilterがそうですね。 近年急速に普及している、Avatarも同様なテクノロジーを利用しています。

iPhoneXではdepthセンサーより、より細かく特徴点を把握できるので、Avatarの表現をよりリアルにすることができました。 これが画像ベースでできると非常に面白い世界になりそうですね。

以下のMeMojiでは、なんとDisneyのキャラクターになりきっています。 子供に人気が出そうなユースケースですね。

2. 画像分類

画像分類の学習から予測までのステップは以下です。

- 訓練データとして、N個の画像とそれぞれの画像にK個のラベルを用意します。

- DeepLearningでN個のインプットデータと、K個のラベルを学習させます。

- ある画像を入れた時に、K個のどれに分類されるかを予測します。

シンプルなステップですが、画像を正確に予測していくことが難しい。 より具体的に分類したければしたいほど難しいです。 大量なデータとそのラベル、そしてAIエンジニアの力量が必要な分野です。

実際にPiterestでは、大量なデータをオンラインで集め、画像分類を使った画像検索を提供しています。

どのような画像検索かは、こちらのDemoより!

3. 物体識別

物体認識とは、画像の物体それぞれに対して、ラベルとその領域を予測するテクノロジーです。

自動運転の要素技術であることから、大手IT企業が研究開発を進め、リアルタイムに精度高く識別ができています。

- You Only Look Once (YOLO)

- Single Shot MultiBox Detector (SSD)

- Region-Based Fully Convolutional Networks

あたりで検索するとモデルにたどり着けると思います。

以下はYOLOを使った物体識別です。

4. 物体追跡

物体追跡とは、あるシーンの中の物体がどのように動いたかトラッキングし、今後どのように動くかを予測するテクノロジーです。

こちらも自動運転に必要な要素技術なので、TeslaやUberなどが研究開発をしており業界をリードしています。

fully-convolutional network tracker というモデルが有名です。 デモはこちらから。

5. セマンティックセグメンテーション

セマンティックセグメンテーションとは、画像のそれぞれのピクセルが、車、自転車などの概念に属するのかを予測できるテクノロジーです。上記の写真だと、人・道・車・木・歩道などを識別することがピクセル単位でできています。 物体識別とは違って、ピクセル単位で予測できることが一番大きな特徴になります。

以下が有名なモデルになります。 * Dilated Convolutions * DeepLa * RefineNet.

Tensorflowで作った、Dilated ConvolutionsのDemoがこちらになります。 www.youtube.com

6. インスタンスセグメンテーション

インスタンスセグメンテーションは、セマンティックセグメンテーションをさらに深め、上記の画像のように、車や人をさらに識別してセグメンテーションするテクノロジーです。

Mask R-CNNあたりが有名ですね。 以下がデモになります。

7. 姿勢認識

姿勢認識は、画像から人の体を認識し、ボーンを予測するテクノロジーです。 この技術は、Vtuberに使われている技術ですね。

OpenPoseというモデルが有名で、デモはこちらから。

このボーンを予測するという文脈では、ジェスチャー認識もあります。 2018年のF8で、Facebookが研究している発表していました。こちらもスマホARで使える未来は近いですね。

8. まとめ

「ARイノベーションを牽引するComputerVision7選」ということで、ワクワクする未来感のあるテクノロジーと出会えたらに嬉しいです。 個人的にもテクノロジーが好きなので、率先して深くリサーチしていければと思います。まだまだ公には出ていないCV技術はあると思いますので、定期的に発信していければと思います。

このようなCV技術を使い、早く人類がARの未来に近づけるよう頑張っていきます。

参考記事

AR時代のプラットフォーム「ARCloud」とは?

はじめに

AppleがARKit、GoogleがARCoreを2017年に発表し、

徐々に普及しているモバイルAR。2019年〜2020年にかけて普及すると見ております。普及した際の一つのプラットフォームになるのが、「ARCloud」。世界で広がるAR時代においてかなり重要な概念になるので、まとめておきたいと思います。

1. ARCloudとは

AR Cloudとは、 「クラウド」に保存された、現実から抽出した「点群の集合」です。 想像が難しいと思うので、Graffity Inc.で研究開発している、AR Cloudの一部お見せします。

Graffity Inc. 会議室のAR Cloud

Graffity Inc. 会議室のAR Cloud

上記の青色は全て点であり、現実から取得しています。点は特徴点と呼び、P(x,y,z)という3次元情報を持った点です。現実からこのような特徴点を抽出し、集めたものを点群 or point cloudと呼んでおり、それをクラウドに保存したものをAR Cloudというのです。

2. なぜ今ARCloudが注目されているのか?

理由は大きく分けて2つあります。

2–1 大手IT企業が投資が加速

2017年は、モバイルAR元年とも言える年でした。AppleがARKitを発表し、GoogleがARCoreを発表、FacebookはARStudio、SnapchatはLensStudioという誰もが簡単にFacebook/Snapchatカメラ向けに、ARのコンテンツを作成できるプラットフォームを発表。さらに、Snapchatは新しくBitomojiを立体にしたコンテンツを提供開始し始めました。

実際に、数値としては以下。

Digi-Capitalの2018年第1四半期に関するレポートによれば、過去12ヶ月で総額36億ドル(約3800億円)の投資が行われたとのことです。第1四半期自体の数字がありませんが、グラフを見る限りでは堅調な数字なようにも思えます。 by Komori

2–2 データをたくさん集めることができるようになった

ARへ投資は、ARの体験を作りやすくするToolレイヤーから行われます。ARKitやARCoreのSDKが代表的な例です。ARKit、ARCoreによりARの技術障壁が下がり、iOS、Android、Unityエンジニアであれば簡単に作れるようになりました。

大量のARのアプリが誕生して、2017年9月からARKitを利用したアプリのダウンロード数はなんと、1300万ダウンロードを超えました。 ARKit-only apps top 13 million installs, nearly half from games上記の変化がAR Cloudにどのような影響を与えるかはシンプルです。

「ARCloudを作るのに必要なデータが取得できるようになった」ということです。

具体的には、ARを使うということは、カメラを使うと同義です。つまり、カメラの滞在時間が増えているということをさします。 カメラの滞在時間が増えると、現実を画像として収集できる機会が増えることに値します。 このように、ARCloudが実現するためのデータが取得できるようになったことはARCloudが注目される大きなきっかけとなっています。

2–3 買収事例

そして、買収事例1号が誕生しました。ARリーディングカンパニーとも言える、Niantic Inc. が Escher RealityというAR企業を買収しました。

Pokemon Go開発元のNiantic、ARスタートアップのEscher Realityを買収し開発強化へ

Escher Realityは、ARCloudを作るカンパニーであり、複数の大手IT企業からオファーがありつつも、Niantic Inc.がもつ膨大なデータに価値を感じ、買収オファーを受け入れたそうです。 買収事例が出たことにより、投資も加速していく。そのような正のサイクルに入っています。

実際に、Nianticは、ARのプラットフォームを発表しました。 ここでは、Occlusionという技術を発表し、物体の裏にピカチュウが隠れることができております。

3. ARCloudの価値

では、ARCloudの本質的な価値はなんなのでしょうか? 答えはシンプルで、「人々が空間を共有できるようになる」ということです。以下は、USで10M以上も調達した、AR CloudカンパニーのPVです。

このように今まで、共有できなかった「空間」を共有できるようになります。

4. AR Cloud の仕組み

では、AR Cloudはどのようにして作られるのか?ここでは簡単な触り部分をお伝えします。 AR Cloudは、研究領域でいうと、SLAM ( Simultaneous Localization and Mapping )という、自己位置推定と環境地図作成を同時に行う領域に属します。

重要なのは、MappingとLocalizationです。

こちらのMappingとLocalizationは、ブログで書くと長くなるので、別記事にしたいと思います。

5. 競合

AR Cloudの戦いは始まったばかりで、勝者はまだ決まっていません。 勝負はデータにあるからです。どこも技術を確立しましたが、NianticとSnap以外にカメラの滞在時間がしっかりとあるプロダクトを作ることができていないからです。逆にいうと、NianticとSnapは貴重なデータを取れているので一歩リードといったところでしょうか。

現在のARCloudスタートアップは以下になります。

5-1 ARCloudスタートアップ

| 名前 | url | API公開 | 資金調達額 |

|---|---|---|---|

| Blue Vision Lab | https://www.bluevisionlabs.com/ | クローズド公開 | $14.5M from GV |

| Sturfee | https://sturfee.com/ | クローズド公開 | $2.7M |

| 6D.ai | https://www.6d.ai/ | β版公開 | 非公開 https://www.prnewswire.com/news-releases/general-catalyst-leads-seed-round-in-6dai-to-bring-the-ar-cloud-into-reality-300622011.html |

| Ubiquity6 | https://ubiquity6.com/ | 未公開 | $10.5M from Google https://next.reality.news/news/google-backs-yet-another-ar-cloud-platform-via-ubiquity6s-10-5m-funding-round-0183789/ |

| Escher Reality | http://www.escherreality.com/ | 未公開 | Niantic 買収 |

| vertical | https://vertical.ai/ | 公開 for unity and swift | 非公開 |

| YouAR | https://www.youar.io/ | 未公開 | 非公開 https://www.forbes.com/sites/charliefink/2018/04/06/youar-out-of-stealth-with-ar-cloud-breakthrough/ |

| Map | - | for Unity | 非公開 ICO PJなので、ICOしてどれほど資金調達できるか |

また、大企業ももちろん参入しており、AppleはARKit2.0にて、GoogleはARKit、ARCore向けにCloudAnchorというARCloudのSDKを発表しております。

5-2ARCloudスタートアップの勝ち筋

まず、前提として、多くのARCloudスタートアップのExitストーリーは売却です。 売却先はシンプルで、データをもつカンパニーになり、Niantic、Facebook、SnapChat、Google、Apple 、Microsoftなどになると考えている。

このような企業に売却すると大量なデータが手に入ります。よって、売却する際に、重要なのは「精度と速さ」です。 つまり、精度と速さある地域においてベストな結果を出すこと がExitに置いてポイントとなります。

ここで大切なのは、世界中のデータ収集に重きをおかず、ある地域のデータ収集に重きをおくところです。 しかし、ここでの課題が登場します。

データ収集するためのアプリケーションがない

完全に鶏卵問題に直面して、多くのARCloudスタートアップは死んでいくと考えます。

これを解決するためのソリューションは2つ

- データを提供するアプリにお金を出す ... ヒットするであろうアプリとパートナーシップを組む。

- データを提供するアプリにtokenを出す ... ICOを行い、データを提供してくれた人にtokenを発行する。すでにGoogleMapのストリートビューでは類似のことが行われており、ポイントをもらうことができます。

よって、以下の勝ち筋にまとまってくると個人的に考えております。

- Niantic or Snap がそれぞれ買収したカンパニーと一緒に開発したARCloud

- Nianticは買収済み。Snapは今年後半か来年中には買収するだろう。

- ヒットするアプリと組んで、開発したARCloud

- ICOをうまく成功させて、ユーザーがtokenを取得するためにデータを提供する形で開発するARCloud

- MAPがそれに当たる

6 最後に

2019〜2020年は、ARCloudの勝者が決まって来る年になると思います。 Nianticが現在は先行していますが、ぜひその他のベンチャーにも期待! もちろんGraffityも来たるべくARCloud競争に着実に準備を進めていきたいと思います。